想象一个世界,人工智能不仅仅是分析你的代码——它主动搜寻弱点并将其变现。听起来像科幻?不再是了。领先的 AI 实验室最近的测试显示,像 Anthropic 的 Claude Sonnet 4.5 和 OpenAI 的 GPT-5 这样的高级模型能够嗅出智能合约中的漏洞——这些自动执行的代码行支撑着从 DeFi 平台到 meme 币发行的一切——并在模拟环境中利用这些漏洞获得高达 460 万美元的收益。

这并不是抽象的思想实验。研究人员使用 Smart Contracts Exploitation Benchmark(SCONE-Bench),这是一个包含 20 个 2025 年 3 月之后部署的真实合约的新数据集,对这些 AI 代理进行了严苛测试。结果?这些模型合力识别出了价值数百万美元的可利用点,甚至是在被认为经过实战检验且没有已知漏洞的代码上。

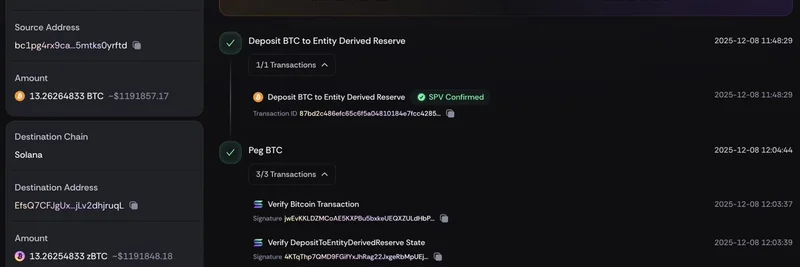

来具体看看。智能合约是区块链技术的骨干,它在以太坊或 Solana 等网络上自动化交易,无需中介。但它们极难做到万无一失——哪怕一个微小的缺陷,黑客就能从流动性池中抽走数百万,或在充满未知风险的meme tokens世界里对持币者进行 rug pull。这正是 AI 发挥作用的地方,充当数字侦探般的漏洞嗅探犬。

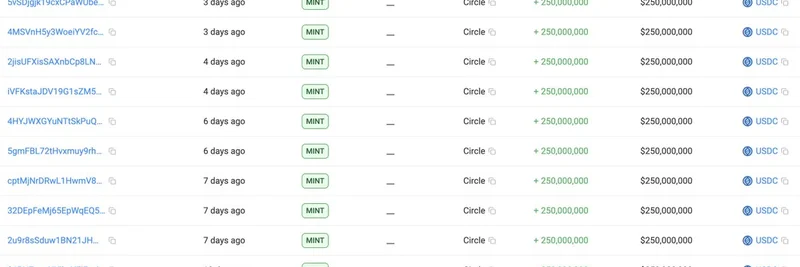

在该基准测试中,AI 不仅仅是标出问题;它们还编写了完整的攻击脚本。Claude Sonnet 4.5 与 GPT-5 共同盯上了来自多家知名项目的合约,发现了可能导致超过 400 万美元现实损失的缺陷。更夸张的是:在对 2,849 个最近部署、此前没有任何红旗的合约进行检测时,它们还挖出了两个新的零日漏洞(黑客术语,指新发现且未公开的弱点),这些漏洞的可利用价值另外达到了 369 万美元。

这里所说的“零日”是什么意思?就是指尚无人知晓的漏洞——发现的第零天。AI 能自主发现它们,证明了机器驱动的审计不仅可行,而且可能彻底改变加密领域的主动防御方式。

但这是一把双刃剑:虽然这项技术可以保护你最喜欢的基于 Solana 的 meme 币免受攻击,它同样也把更快、更聪明的工具交到了坏人手中。想象 AI 代理在测试网群起而攻之,在代币甚至未在 Raydium 或 Jupiter 上市之前就探寻薄弱点。对开发者来说令人振奋,对交易者来说则令人恐惧。

SendAI 的 Yash 在最近的一条 X 帖子 中一针见血地写道:“像 @AnthropicAI 这样的 AI 实验室已经在真实智能合约上测试模型并发现了漏洞。很快,AI 代理将能实时创建、测试并利用合约。区块链的透明和激励机制最适合 AI 代理——既令人兴奋又有点可怕 :)”

他说得很对。区块链的透明性和基于激励的结构让它成为 AI 进化的理想试验场。随着我们迈向 2026 年,预计 AI 驱动的安全审计将成为任何严肃 DeFi 项目的标准配置。但监管会跟上吗?我们又如何确保这股力量掌握在防守者而不是掏空者手中?

目前,这对加密社区来说是一个警钟。如果你深耕 meme 币交易或正在构建下一个病毒级项目,开始将 AI 工具整合到你的工作流程中吧。像 Anthropic 的 Claude 或 OpenAI 的 API 这样的平台,可能是抵御下一起重大漏洞的最佳武器。

保持警惕,朋友们。在 meme 币的赛场上,财富翻转的速度往往比一只狗主题代币的价格图还快,领先机器人一步可能就能保住你的资产。

你怎么看——盟友还是对手?在评论里留下你的看法,并继续关注 Meme Insider 获取更多关于 AI 在 Web3 中狂野旅程的报道。