在区块链和 meme 代币这个节奏极快、创新如闪电般推进的世界里,人工智能(AI)的角色正变得越来越重要。但强大的能力也带来更大的责任——在这里,也可能带来许多潜在陷阱。Cantina 和 Spearbit 两家知名区块链安全公司的 CEO Hari Krishnan 在一条推文中就揭示了这一不断演进的讨论。Krishnan 以其在 Solidity(很多以太坊智能合约背后的编程语言)方面的工作而闻名,他指出开源项目正努力应对 AI 的整合问题。

Krishnan 提到,若干开源倡议正采取严格的反对 AI 使用政策,主要是因为这给开发者带来额外的维护负担。作为一家审核大量 AI 生成代码提交的安全平台负责人,他开始有了不同的看法。“真正的解决方案是用 AI 对抗 AI。它既是药,也是毒,”他打趣道。这个观点对 meme 代币的创建者尤其重要:他们往往依赖快速生成的代码来推出 viral 项目,但这也可能引入漏洞,最终导致被利用或 rug pull。

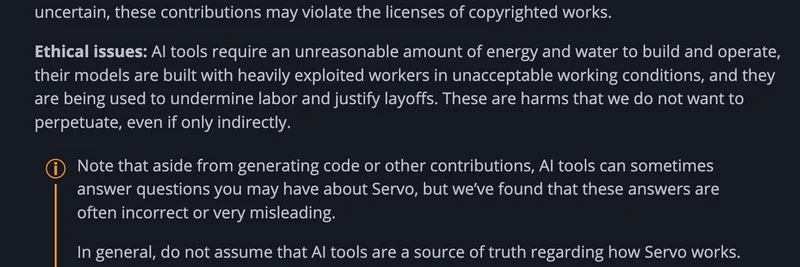

为说明他的观点,Krishnan 分享了 Servo 文档的部分摘录。Servo 是一个最初由 Mozilla 开发、现为 Linux Foundation 一部分的实验性浏览器引擎。Servo 旨在为未来的网络技术提供动力,可能包括 web3 应用。文档列出了对 AI 工具的严重担忧:

AI 的版权和伦理困境

Servo 团队指出,公开可用的 AI 模型常常会以受版权保护的材料进行训练,有时甚至是有意为之,导致输出会逐字复现受保护内容。在法律上这一灰色地带可能会给采用 AI 生成代码或资产的项目带来麻烦,尤其是在讲求透明度和所有权的区块链领域。对于 meme 代币的开发者来说,使用 AI 快速生成智能合约代码可能无意间侵犯现有代码库,从而在未来引发法律问题。

在伦理层面,AI 的发展经常牵涉到在恶劣条件下被剥削的劳动者,破坏了公平的劳动实践。即便是间接参与,也会延续这些伤害——这对倡导赋权与公平的 web3 去中心化精神来说,值得深刻反思。

不准确的 AI 回答的陷阱

Servo 文档中的一个关键警告是:AI 工具可能会生成有关项目的代码或答案,但它们往往是错误或具有误导性的。“不要假设 AI 工具是关于 Servo 如何工作的可靠来源。请考虑改为在 Zulip 上提问,”文档建议。Zulip 是一个开源聊天平台,这里强调的是人类专业知识而非算法的猜测。

这在 meme 代币领域有着强烈共鸣。试想根据 AI 的建议部署了代币合约,却在后续发现存在关键漏洞。像 Spearbit 这样的区块链安全公司经常审计此类代码,Krishnan 的经验表明 AI 生成的提交中错误频出。对有意创建 meme 代币的人来说,这凸显了社区论坛(如 Discord 或 Telegram)比盲目依赖聊天机器人更重要的人类监督价值。

社区反应与更广泛的影响

该推文引发了热烈讨论。一位用户将其比作早期互联网时代网站屏蔽爬虫的做法,暗示对新技术的抵制往往会演变。另一位用户则强调“AI 是答案,而不是问题”,主张要聪明地整合 AI。还有回复认为在开源中禁止 AI 是权宜之计;未来在于把 AI 检测器内建到工作流程中。

对于区块链从业者,尤其是 meme 代币生态中的人来说,这些见解非常宝贵。meme 代币靠炒作和快速部署蓬勃发展,但要实现可持续性,就需要强健的安全保障。AI 等工具能加速开发——比如生成 ERC-20 模板合约或 NFT 元数据——但必须配合人工审查和安全审计。

如果你正在构建下一个大热的 meme 币,考虑采纳 Krishnan 的建议:谨慎利用 AI,或许把它用于初稿生成,同时使用先进的 AI 检测器来标记问题。像 Cantina 和 Spearbit 这样的公司正走在这场 AI 对抗 AI 的前线,确保智能合约更安全。

最终,随着 web3 的成熟,如何在创新与伦理之间取得平衡将决定成败。无论你是在开发像 Servo 这样的浏览器引擎,还是在发布一枚以狗为主题的代币,记住:AI 是工具,不是拐杖。积极参与社区,核验来源,负责任地构建,才能在保持 meme 魔力的同时避免灾难。

想了解更多区块链技术趋势和 meme 代币策略,请访问 Meme Insider 的我们的知识库。