在 Solana Breakpoint 探索 x402、LLMs 与 Arcium:面向 Meme 币爱好者的洞见

深入了解 Solana Breakpoint 上关于 x402 小额支付、AI 大型语言模型(LLMs)和 Arcium 隐私技术的最新议题,发现这些创新如何可能革新 meme 币和区块链生态。

深入了解 Solana Breakpoint 上关于 x402 小额支付、AI 大型语言模型(LLMs)和 Arcium 隐私技术的最新议题,发现这些创新如何可能革新 meme 币和区块链生态。

探讨接触垃圾社交媒体数据如何对大型语言模型造成持久损害,以及这对在 meme token 交易、情绪分析和区块链开发中使用的 AI 工具意味着什么。

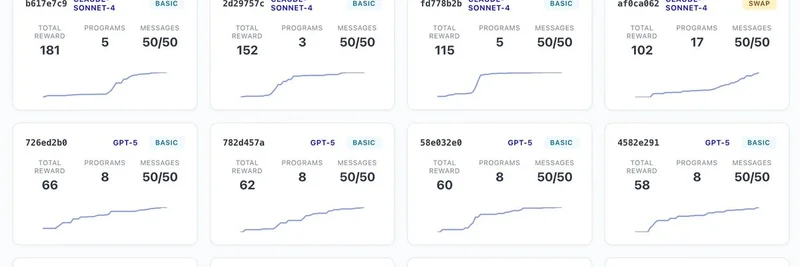

了解 AiMo Network 最新与 Venice AI 的整合如何改变去中心化 AI,为区块链用户提供私密且不受审查的大型语言模型。

深入解析 Andrej Karpathy 在 X 上关于将大型语言模型比作“幽灵”而非“动物”的病毒式推文,并发现这类 AI 梗是如何激发区块链领域下一波 meme 代币创新的。

了解 Dialect 的 Standard Blinks Library 如何让像 Claude 这样的 LLM 处理 Solana 上复杂的 DeFi 操作,并回应最新的 Solana Bench AI 性能基准。

探讨为什么 AI agents 和 LLMs 并未在开发者的 GitHub 贡献中带来指数级增长,并包含加密专家 Hari Krishnan 对编码工作流的见解。

探索为大型语言模型(LLM)设计有效提示如何迫使你条理化思考,从而在梗币开发和区块链创新中带来更清晰的愿景。

深入了解大语言模型(LLMs)如何被用来制作复杂的网络钓鱼信息,带来2025年全新的网络安全挑战。

探索Alessandro Decina在X上引发的关于大型语言模型(LLM)是否可与初级工程师相提并论的辩论。深入了解利弊及现实见解!